Les dark patterns, selon la DGCCRF, sont des pages et des messages internet trompeurs qui poussent les internautes à faire des actions qu’ils n’auraient pas faites en temps normal.

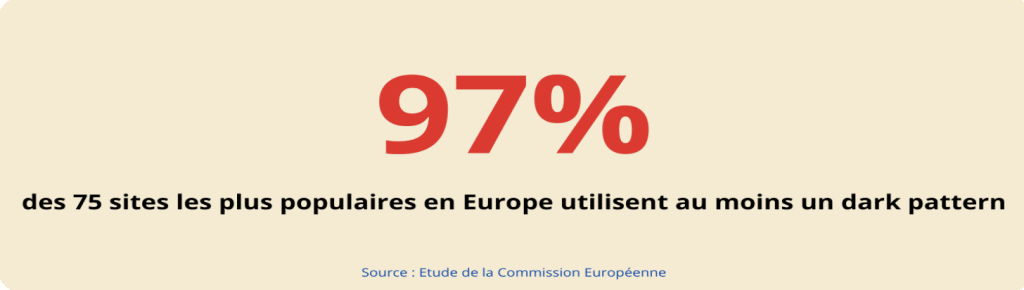

Depuis des années, les dark patterns envahissent le web. Une étude de la Commission européenne révèle que 97% des 75 sites les plus populaires y ont recours. Le flou juridique qui a longtemps profité aux plateformes semble enfin terminé, au regard de Shein qui vient d’être condamnée à verser 40 millions d’euros pour pratiques commerciales trompeuses.

Derrière les comptes à rebours factices, les cases pré-cochées et les parcours de désabonnement labyrinthiques, se cache une véritable ingénierie de la manipulation.

En s’appuyant sur les neurosciences, ces interfaces exploitent nos biais cognitifs pour nous guider à notre insu, transformant notre libre-arbitre en une simple variable d’ajustement. Un système opaque, redoutablement efficace, dont les ramifications dépassent de loin la simple relation commerciale.

Dominique Boullier, professeur en sociologie à Sciences Po Paris et auteur d’ouvrages sur le numérique, nous a accordé une interview afin d’apporter son expertise notamment sur les pratiques et la réglementation des dark patterns.

Une manipulation d’un genre nouveau

Le terme “dark pattern”, inventé en 2010 par le Dr Harry Brignull, désigne ces interfaces conçues pour tromper le consommateur. Sur son site “deceptive.design”, il a posé les bases d’une prise de conscience majeure et son travail a non seulement permis de dénoncer ces pratiques, d’inspirer des recherches académiques, mais aussi des évolutions législatives pour mieux protéger les utilisateurs.

Quant à B.J Fogg, sociologue et professeur à Stanford, il enseigne, depuis de nombreuses années, les principes de la persuasion numérique et de l’éthique dans la conception des technologies. Il a consacré beaucoup d’énergie à sensibiliser ses étudiants aux usages responsables du numérique. Pourtant, ces enseignements ont été détournés, notamment par d’anciens élèves, travaillant aujourd’hui dans la Silicon Valley, afin de créer ces techniques manipulatrices. L’enfer est pavé de bonnes intentions.

Si la manipulation commerciale n’est pas nouvelle, les dark patterns sont les héritiers numériques du “pied dans la porte” des démarcheurs à domicile. La relation vendeur-consommateur a toujours oscillé entre satisfaction et tentation de manipulation, internet n’y échappe pas, seule sa nature change.

Comme l’explique Dominique Boullier, professeur de sociologie à Sciences Po et spécialiste du numérique, la différence repose sur deux piliers : la personnalisation et le rythme.

La première différence, “c’est le degré de personnalisation. (…) Il est possible de mobiliser des goûts dans des domaines très différents pour créer un pattern qui oriente les placements publicitaires”, explique-t-il, avant d’aborder le second facteur : “Le rythme et la durée. (…) Les algorithmes ont une capacité à suivre l’activité très finement (…), à répéter l’opération en permanence. Ça crée une forme de « trap » qui capte le public durablement.”

Aujourd’hui, ces traquenards numériques sont devenus plus élaborés et ciblent des mécanismes cérébraux dont nous ignorons souvent l’existence. Ils s’imposent à chacun et nul n’est à l’abri.

Les grandes familles de dark patterns

On distingue plusieurs grandes familles de dark patterns, d’après le livre d’Harry Brignull “Deceptive Patterns: Exposing the Tricks Tech Companies Use to Control You” (2023) :

Le sneaking, où l’art de se faufiler

l’ajout discret de produits ou frais cachés dans votre panier.

L’urgence, où le tic-tac qui pousse à l’achat compulsif

Qui n’a jamais vu le compte à rebours qui provoque ce sentiment d’urgence ? À peine convoité il y a deux minutes, ce produit devient indispensable, poussant à l’achat compulsif.

Le détournement, les émotions au service du mal

Utiliser des éléments visuels ou un langage confus pour rediriger l’attention à l’insu de l’utilisateur (désinscription difficile, bouton de refus des cookies inexistant).

La preuve sociale, où l’effet mouton 2.0

Rien de tel que de voir une file d’acheteurs fictifs ou des avis surjoués pour nous convaincre que, décidément, tout le monde s’arrache ce produit… et qu’on ferait bien de ne pas passer à côté.

La rareté, ou le mirage de l’ultime occasion

Faire croire que le stock fond comme neige au soleil, pour pousser à cliquer vite, avant que le précieux objet ne disparaisse à jamais… même si demain, il y en aura probablement autant.

L’obstruction, on sait quand on arrive, mais pas quand on repart

Quand chaque clic devient un parcours du combattant où le découragement guette l’utilisateur à chaque étape.

Action forcée, inscris-toi d’abord

Ici, impossible d’avancer sans céder à une demande imposée — renseigner des données personnelles, accepter des conditions ou s’abonner à une newsletter, sous peine de rester bloqué à la porte du service.

“Ca devient tellement opaque que c’est totalement imperceptible pour le client” souligne Dominique Boullier.

Mais l’objectif le plus profond et le plus méconnu, révélé par notre expert, est ailleurs. Contrairement à ce que l’on pense, les marques elles-mêmes sont de plus en plus aveugles et le but des données collectées n’est souvent plus la vente directe.

“Les marques connaissent de moins en moins de choses et ne peuvent quasiment rien tester” précise le professeur, “(…) On croit toujours que les données servent à gagner des clients, mais en fait, elles donnent des signaux aux investisseurs. Ça permet de positionner la marque dans la course à la réputation, qui est très importante pour attirer les investisseurs. On est dans une économie financière.”

Mais pourquoi tombons-nous aussi facilement dans ces pièges ?

D’après plusieurs études de la Commission européenne, les dark patterns sont partout sur Internet. Sur 399 boutiques en ligne, 148 pratiquent la manipulation en ligne. Les consommateurs sont soumis quotidiennement à la contrainte et à la manipulation altérant leur prise de décision.

Si ces techniques sont si efficaces, c’est qu’elles exploitent les biais cognitifs. Hérités de la préhistoire, ces mécanismes de “défense évolutive” ont permis la survie de l’humanité dans un monde hostile. Les biais cognitifs nous permettent de prendre des décisions rapidement en économisant de l’énergie. C’est une compétence adaptative. Mais ce mécanisme peut, dans certains cas, conduire à des choix irrationnels, surtout dans des situations complexes de traitement de l’information. Ils influencent le jugement, la perception et la prise de décision. Les dark patterns exploitent précisément ces failles pour manipuler les comportements en ligne.

Les biais cognitifs couramment utilisés sur les sites marchands

On recense plus d’une centaine de biais cognitifs qui, d’après de nombreuses études, confirment leur prévisibilité, leur caractère inconscient et involontaire.

Les plus couramment exploités sont :

- Biais d’ancrage : tendance à accorder plus d’importance à la première information reçue. Ex : prix barré.

- Aversion à la perte : la peur de perdre un avantage, presque plus importante que le produit lui-même. Ex : “offre valable jusqu’à minuit”, “frais de port réduits”.

- Effet de cadrage : la manière de présenter l’information influence la décision. Ex : 1€ par jour semble plus accessible que 365 € par an.

- Preuve sociale : tendance à suivre l’avis du groupe ou à copier un comportement. Ex : faux avis, affichage d’achats en cours.

- Pression temporelle : prise de décision de manière précipitée sous la contrainte temporelle. Ex : compte à rebours, phrase incitative “dernière chance”.

Ces biais cognitifs nous conditionnent dans notre réponse au monde numérique et offrent aux plateformes une carte de nos schémas mentaux, prévisibles et inconscients. Dominique Boullier explique que “si quelqu’un enchaîne plusieurs types de pages, on obtient un “graph social”, et la probabilité que l’utilisateur réagisse à une telle publicité peut être mesurée immédiatement. Ce sont des allers-retours d’apprentissages, des combinaisons, qui permettent aux plateformes d’apprendre beaucoup”.

Une dette de réputation pour les marques et le référencement

Au-delà de la frustration des utilisateurs, les conséquences des dark patterns sont bien plus larges que la simple décision d’achat, elles surchargent les services d’annulation, elles altèrent la confiance dans une marque ou un produit. Une étude de PWC montre que des consommateurs abandonnent une marque après plusieurs mauvaises expériences.

Les répercussions pour les marques sont colossales, la simple fidélité client n’est pas seulement en jeu. Elles jouent avec la réputation acquise au prix de nombreuses années de communication et de travail. De plus, aujourd’hui avec les réglementations et lois telles que le Digital Services Act, elles encourent des amendes importantes.

- LinkedIn, en 2015, a payé 13 millions de dollars suite à un recours collectif pour son “social spamming”.

- Epic Games, éditeur du jeu vidéo Fortnite, a versé le plus gros remboursement jamais ordonné par la FTC (Federal Trade Commission) : 520 millions de dollars, dont 245 aux consommateurs floués. L’indignation des parents fut immense et la crédibilité d’Epic Games mise à rude épreuve.

- Amazon, quant à lui, a vu sa réputation de “service pratique” ternie par son processus de désinscription labyrinthique à Prime (surnommé “l’Iliade” en interne chez Amazon).

Malgré la réparation, le coût pour restaurer la confiance est immense. L’utilisateur bafoué viendra moins souvent, consommera moins spontanément et ne recommandera pas ou peu la plateforme. C’est une dette de réputation dont le montant final dépasse toujours les gains à court terme de la manipulation.

Les répercussions sur le SEO et le SEA

Cette expérience utilisateur dégradée a également un impact direct sur le référencement. L’algorithme de Google, via des mises à jour comme Helpful Content ou les signaux E-E-A-T (Experience, Expertise, Authoritativeness, Trustworthiness), pénalise les sites qui ne fournissent pas une expérience utilisateur de qualité ou digne de confiance.

Cela se traduit par :

- Le masquage d’information comme l’absence claire de prix ou la reconduction automatique de l’abonnement.

- Les fausses urgences avec des comptes à rebours

- Le pogo-sticking

- L’affirmation de stock limité

- Les faux boutons de lecture menant vers des publicités

Sur Google Ads, la sanction est encore plus directe, puisqu’une page qui utilise des dark patterns verra son annonce tout bonnement refusée, voire son compte publicitaire suspendu en cas de récidive. Si le chiffre d’affaires dépend de Google Ads, la perte sera catastrophique.

Régulation VS réalité : un combat inégal

Harry Brignull pensait que le meilleur rempart contre les dark patterns était la connaissance. Sur son site, il a répertorié ces procédés et encourageait la bonne volonté de chacun avec l’idée d’une éthique collective, mais il a vite réalisé que seule la loi pouvait réellement protéger les utilisateurs.

Face au phénomène, la législation se durcit. En France, le Code de la consommation protège les utilisateurs des pratiques déloyales, agressives et trompeuses d’après les articles L121-2 et L121-7.

Les contrevenants encourent une amende pouvant aller jusqu’à 10% du chiffre d’affaires annuel, 50% des dépenses publicitaires ou 1 500 000 €.

Au niveau européen, le RGPD et surtout le Digital Services Act (DSA), en vigueur depuis le 17 février 2024, interdisent explicitement les dark patterns sur les plateformes en ligne.

L’article 25, paragraphe 1 du DSA mentionne que “les fournisseurs de plateformes en ligne ne conçoivent, n’organisent ni n’exploitent leurs interfaces en ligne de façon à tromper ou à manipuler les destinataires de leur service ou de toute autre façon propre à altérer ou à entraver substantiellement la capacité des destinataires de leur service à prendre des décisions libres et éclairées. (…)”

Dans la législation française, l’article 82 de la loi Informatique et Libertés adapte les règles européennes du DSA, notamment concernant “l’obligation d’obtenir le consentement des utilisateurs avant d’utiliser des cookies ou autres traceurs”. Parmi les grands principes de cet article de loi, on peut lire : “Les utilisateurs devront être en mesure de retirer leur consentement, facilement, et à tout moment (…). Refuser les traceurs doit être aussi aisé que de les accepter.”

La DGCCRF, l’ARCOM, la CNIL, la Commission Européenne et la FTC multiplient les actions, enquêtes et sanctions. La Commission, en vertu de la loi sur les services numériques, demande régulièrement aux grandes plateformes de rendre des comptes sur leurs pratiques. Elles sont invitées à fournir un rapport complet, justifiant leur respect des dispositions du DSA. La Commission détermine, après évaluation des réponses, la suite à donner et peut infliger des amendes, conformément à l’article 74 (2) du DSA.

À l’image de Tagadamédia, courtier en données qui a été sanctionné par la CNIL à hauteur de 75 000 euros pour avoir collecté des données sans consentement. L’enseigne Sephora, qui avait déjà payé une amende de 200 000 euros en 2021 pour pratiques trompeuses, s’est faite à nouveau épingler en 2022 pour violation du RGPD et du CCPA, et s’est acquittée de la somme de 1,2 million de dollars.

Pourtant, la réglementation et les sanctions, bien que médiatisées, semblent dérisoires face à la puissance des plateformes. Pour Dominique Boullier, elles sont “un caillou dans la chaussure. Les sanctions financières sont vraiment un tout petit grain de sable. (…) Ce contre quoi les plateformes sont vent debout, c’est tout ce qui les obligerait à ouvrir les algorithmes et à subir des inspections de détail.”

L’opacité des très grandes plateformes

17 très grandes plateformes, qui ne peuvent néanmoins se soustraire aux demandes et décisions de la Commission Européenne dans le cadre du DSA, ont reçu, début 2024, une demande d’informations formelles. AliExpress, Amazon Store, AppStore, Booking.com, Facebook, Google Play, Instagram, LinkedIn, YouTube, Google Search, entre autres, sont concernés.

Le cœur du problème réside dans le manque de transparence. Notre expert se désole : “Le problème, c’est que dans « dark pattern », il y a « dark ». (…) Pour exercer un contrôle, il faudrait obliger à ouvrir les algorithmes. Or, les firmes refusent, considérant que c’est de la propriété industrielle. Le rapport de force n’est pas suffisant du point de vue du régulateur. On effleure le phénomène juste sur les effets en surface.”

En France, comme au niveau européen et international, les associations et autorités enquêtent et sanctionnent. Les nombreuses réclamations et mobilisations citoyennes en ont fait un enjeu de politique publique.

La DITP et la DGCCRF ont lancé une expérimentation pédagogique en diffusant une fausse publicité avec des dark patterns sur Facebook. Près de 2 600 personnes ont acheté le produit fictif. Après coup, elles ont été informées du piège pour les sensibiliser aux manipulations en ligne, dans l’espoir de provoquer une prise de conscience.

Une UX éthique a des bénéfices sur le long terme, puisqu’elle renforce la confiance des utilisateurs et assoit une réputation solide des marques.

Le désir de transparence, de simplicité et de respect de l’utilisateur sont autant de bonnes pratiques plébiscitées. Mais l’idée d’une autorégulation par des chartes éthiques est balayée d’un revers de main par le sociologue :

“Ce n’est absolument pas viable avec ce type d’entreprise. (…) Ils se comportent avec les réseaux sociaux comme des bandits depuis 15 ans. Leur faire signer des chartes éthiques, ça ne marche pas. Il n’y a que le gendarme, l’inspection profonde et des sanctions qui ne sont plus seulement financières, mais juridiques, comme le démantèlement.”

Dominique Boullier

Conclusion

On a longtemps cru que le web était un terrain de jeu neutre où l’utilisateur avançait librement. Mais en faisant surgir des pop-ups insistants, en pré-cochant des cases et en imposant des comptes à rebours qui clignotent comme des gyrophares sur l’autoroute, les dark patterns révèlent une réalité où nos choix sont constamment influencés. Ils exploitent nos biais, nos réflexes, nos failles. On croit choisir, on obéit. Si leur efficacité à court terme n’est plus à démontrer, leurs effets sur la confiance et la fidélité des utilisateurs interrogent la viabilité de ce modèle.

Face à ce constat, la véritable voie d’avenir pour le marketing est moins idéaliste que stratégique. L’enjeu n’est pas de renoncer à la performance, mais de la réaligner sur la confiance.

La feuille de route est claire : concevoir des parcours utilisateur qui placent la transparence et le respect du choix au cœur de la stratégie, comme des composantes-clés de l’expérience client. Cet équilibre entre performance et éthique n’est plus une option, c’est un engagement sur le long terme. Le respect de l’utilisateur génère une valeur supérieure : fidélité, engagement qualifié, image de marque renforcée.

La confiance est la nouvelle conversion.

Construire un numérique de confiance, c’est finalement faire le pari d’une relation qui dure. À l’heure où chaque interaction compte, il appartient à chacun – concepteurs, décideurs, utilisateurs – de faire du web un espace sûr, où l’intelligence collective prime sur la ruse individuelle. Contribuons à créer un environnement digital plus responsable, où l’humain, et non l’algorithme, est au centre du jeu.

Bibliographie et sources

Ouvrages

- Ouvrages de Dominique Boullier : Sociologie du numérique, Éditions Armand Colin, 2e éd, collection U, 2019, 352p. Comment sortir de l’emprise des réseaux sociaux, Editions le passeur, 2020, 301p

- Brignull, H. (2023). Deceptive Patterns: Exposing the Tricks Tech Companies Use to Control You.

- Kahneman, D. (2011). Thinking, Fast and Slow (trad. fr. Système 1 / Système 2 : Les deux vitesses de la pensée).

Rapports Institutionnels et Études

- Commission Européenne. (2022). Behavioural study on the effects of dark patterns on consumers.

- DGCCRF. (2021). Pratiques commerciales trompeuses sur internet : la DGCCRF publie son rapport d’enquête.

- Global Privacy Enforcement Network (GPEN). (2024). GPEN Sweep 2024: ‘Deceptive Design Patterns’.

- Ministère de la Transformation et de la Fonction Publiques (DITP). (2023). Rapport de diagnostic : lutter contre les pratiques commerciales déloyales en ligne.

- OECD. (2022). Dark commercial patterns.

- PricewaterhouseCoopers (PwC). Consumer Intelligence Series: Customer Experience.

- Princeton University & University of Chicago. (2019). Dark Patterns at Scale: Findings from a Crawl of 11K Shopping Websites.

Textes de loi

- Règlement (UE) 2022/2065 du Parlement européen et du Conseil du 19 octobre 2022 relatif à un marché unique des services numériques (Digital Services Act).

- Loi n° 78-17 du 6 janvier 1978 relative à l’informatique, aux fichiers et aux libertés (Loi Informatique et Libertés), notamment l’article 82.

- Code de la consommation, articles L121-2 et L121-7.

Articles et Sites Web

- Assemblée Nationale. Question au Gouvernement N°9057 sur les « dark patterns ».

- Boullier, D. (2018). « Manipulation informationnelle et psychologique », Le Monde, blog Binaire.

- Boullier, D. (2021). « Souveraineté et numérique : maîtriser notre destin », The Conversation.

- CNIL. Règles sur les cookies et autres traceurs et Lignes directrices modificatives.

- Deceptive.design (site web de Harry Brignull).

- Economie.gouv.fr. Pièges sur les sites de commerce en ligne : attention aux « dark patterns ».

- Fogg, B.J. BJ Fogg’s Behavior Model (site web).

- Vie-publique.fr. DSA : le règlement sur les services numériques.

- UFC-Que Choisir. Dark patterns sur les sites d’e-commerce : l’UFC-Que Choisir appelle les autorités à sanctionner les interfaces trompeuses.

/swpm_protected]